实现让用户觉得能用、好用、爱用的辅助驾驶,到底需要什么配置?

"从复杂的立交桥、大量的施工和人车混行路段,到城市中各种不常见的异形障碍物,纯视觉方案很难应对中国城市的复杂路况。"在近日举办的首届「轻舟智航技术工坊」活动上,轻舟智航联合创始人、CTO侯聪指出,"随着技术的持续迭代,纯视觉方案最终也许可以解决城市NOA的难题,但在现阶段,一颗激光雷达的城市NOA是最务实的方案,可在保证安全性的前提下,实现最优性价比。"

感知是城市NOA的重要基础。针对复杂多变的道路交通环境,城市NOA对感知算法观察和认知世界、并为下游任务提供有效数据支撑提出了极高要求。感知模型为了更好地满足城市NOA在车端部署,需要提供精准高效的感知融合算法,满足车规级计算平台的适配,并有效解决复杂路况中的各种长尾问题。

在本次「技术工坊」中,轻舟智航揭开了其在感知技术方面的最新成果——以「超融合」感知方案实现更优感知效果,并提出了更适合量产计算平台的新一代端到端感知全能模型,同时还做到了将激光雷达「物尽其用」,解决各类场景难题,为城市NOA的「万丈高楼」奠定良好的「地基」。

「超融合」感知方案:多传感器时序穿插融合,按需融合优势互补

凭借全栈自研的技术体系,以及强大的数据驱动能力,轻舟智航以独特的「超融合」感知方案引领了行业创新方向,其领先的「多传感器时序穿插融合」技术可让感知模型在不同阶段利用不同传感器信息相互补充,从而得到更准确的结果。

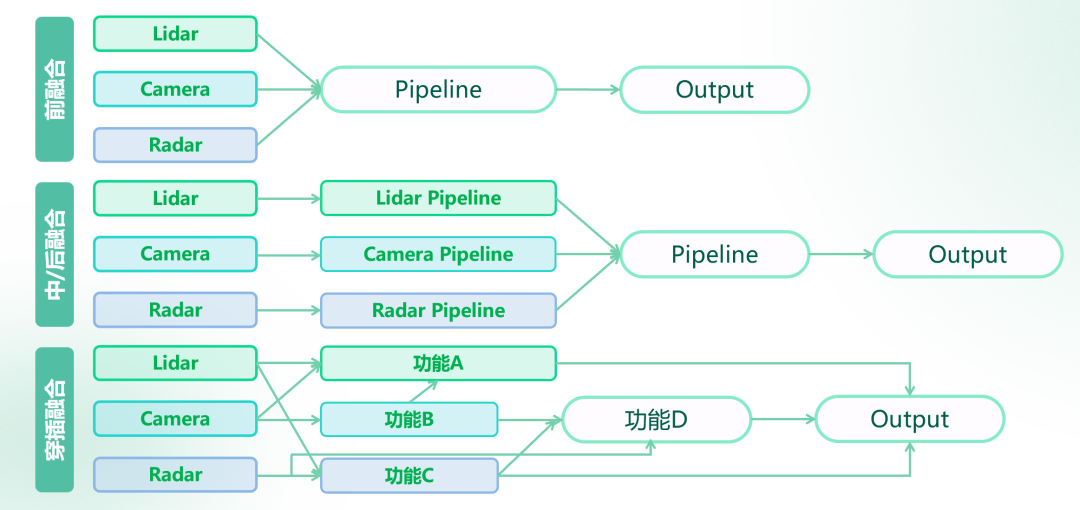

主流的融合方案包括前融合(数据级融合)、中融合(特征级融合)和后融合(目标级融合)三种。不同融合方案各有优劣,有效的融合结果才能给下游任务输出可靠的信息,为车辆做出安全的预测和决策提供保障。

前融合可以实现更高质量的融合效果,但对于不同传感器的时间同步性和空间标定的要求非常苛刻。而后融合的解耦性更强,但依赖经验丰富、工程素养良好的工程人员编写基于经验的规则,同时需要大量的仿真、实车测试以获得更广的覆盖度,并且可扩展性有限,工程投入边界收益低。

融合方式的对比

融合方式的对比

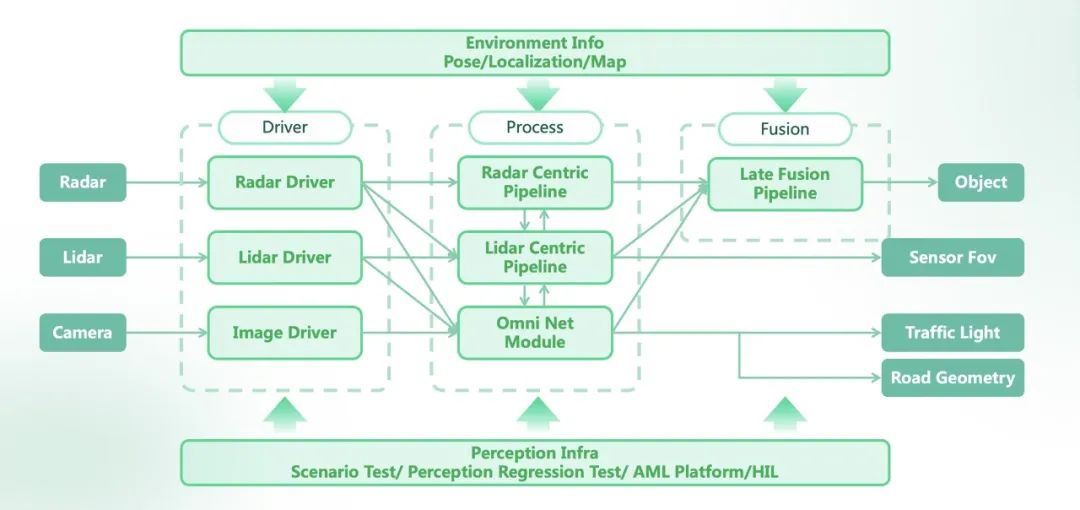

轻舟智航基于"超融合"思想的感知框架

轻舟智航的「多传感器时序穿插融合」在对激光雷达、毫米波雷达、视觉等多传感器进行融合时,其感知模型打破前中后融合界限,在不同阶段根据需求将不同数据给到不同的计算单元,且各计算单元之间也会有信息的交流。这种融合方式可以充分利用不同传感器信息,让不同传感器优势互补,可以避免单模信息丢失,实现更早的多传感器信息共享,得到更优传感器融合结果。

因此,「多传感器时序穿插融合」能够更准确更精细地感知动静态物体及状态信息,避免各类误检和漏检,精度高且鲁棒性强。而「时序融合」就像人脑的记忆模块,可以迅速调起历史信息和当前观测交叉验证,从而得到更稳定的效果。

OmniNet:国内首次在量产计算平台实现多传感器特征和时序融合的大模型

基于「超融合」感知方案,为助力加速城市NOA前装量产,轻舟智航在行业内首次将时序多模态特征融合的大模型OmniNet部署在量产平台上,以一个神经网络即可实现视觉、激光雷达、毫米波雷达在BEV空间和图像空间上输出多任务结果。

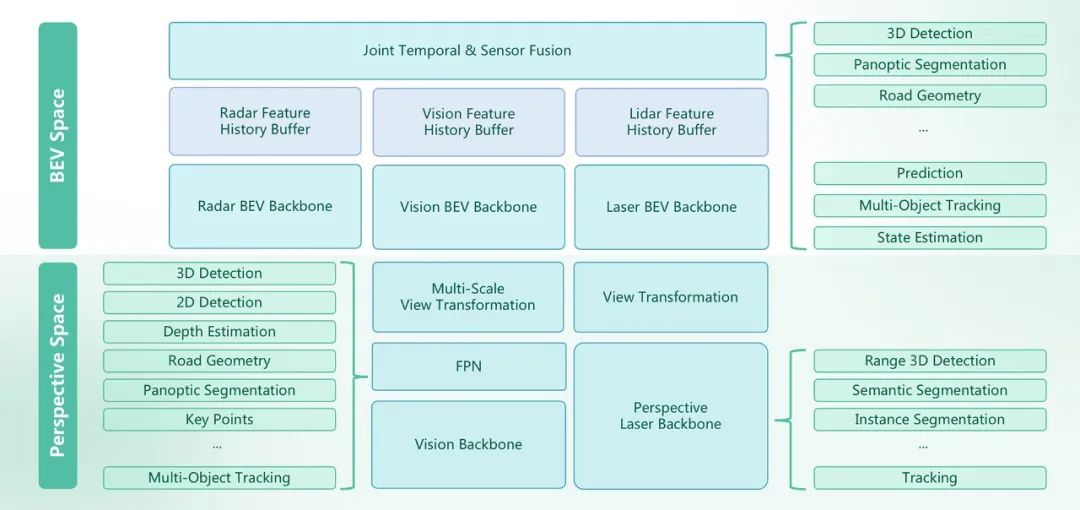

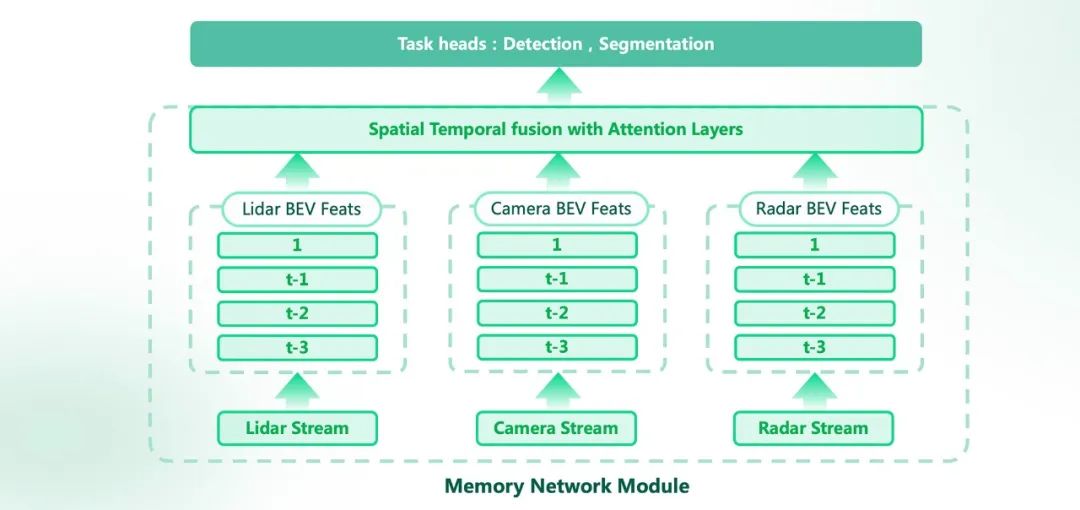

OmniNet是应用于前中融合阶段、实现数据/特征融合的全任务大模型,也是首个可在量产计算平台上实现时序多模态特征融合的大模型。利用一个神经网络模型,将多传感器等数据通过前融合和BEV空间特征融合,以及时序融合,进一步提升模型效果,实现模型内部"可学习"的「超融合」模块。此外通过共享网络,模型可以让本来独立的各个计算任务进行高效多任务统一计算,并同时在图像空间和BEV空间中输出不同感知任务的结果,为下游的预测和规划控制模块提供更丰富的输出。

OmniNet取名自Omnipotent,象征「无所不能的感知融合能力」,意为作为感知主模型,一模型有完成感知所有核心任务的能力。

相较传统方案,OmniNet“感知更精准、车端更适配、迭代更高效”——可提供更丰富且准确的环境感知结果,有效提升感知精度;可节省2/3的算力资源,满足车规级芯片应用需求,并可低成本适配不同车型不同等级的传感器配置;更适宜通过数据驱动解决实际道路面临的长尾问题,更好地满足城市NOA的量产需求。

OmniNet模型架构

OmniNet中的超融合

感知更精准:提供丰富且准确的环境感知结果,有效提升感知的精度和准确性

OmniNet采用了多传感器、多层级、时序融合的方式,能够让多传感器信息相互补充,充分发挥各传感器的优势,输出丰富且准确的环境感知结果,极大的提高了自动驾驶的安全性和舒适性。

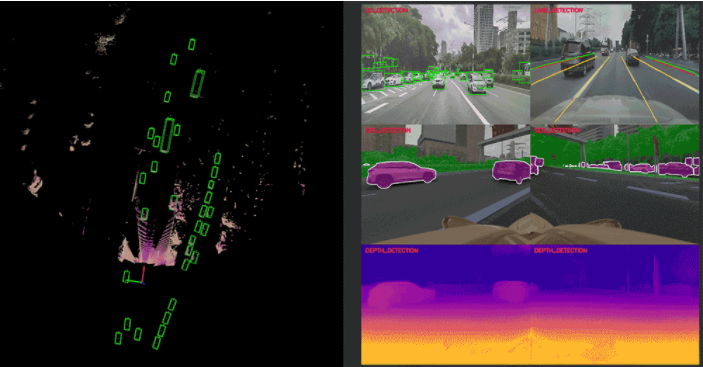

OmniNet多任务结果

通过使用业界领先的视觉BEV检测方案,OmniNet将各视角的图像信息在BEV空间下进行融合,能够准确且稳定地识别超长车辆、异形车辆、跨相机截断物体等,同时也让模型更加方便的将视觉信息和激光雷达、毫米波雷达信息在模型内进行时序融合。

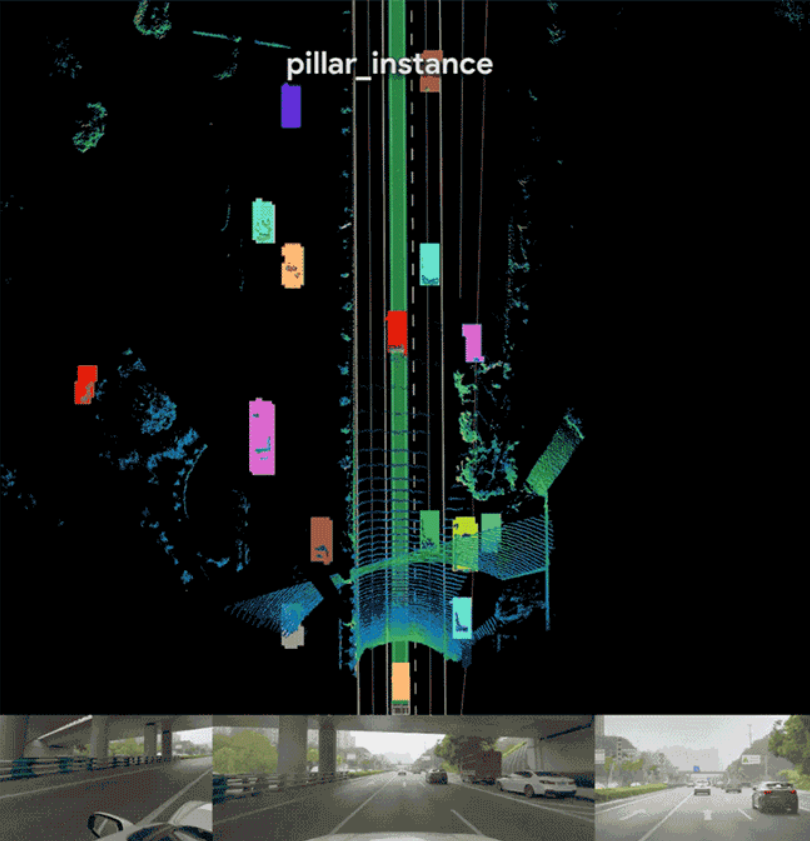

对异形车辆识别

在BEV空间,模型可以通过激光雷达和图像的融合同时获得准确的3D位置信息和丰富的图像语义信息。例如,OmniNet会输出类似于Tesla Occupancy Network的占据格栅信息,并提供每一个占据栅格的语义、实例、运动状态等信息。在前向LiDAR区域内,相比Tesla一类的纯视觉占据珊格网络,OmniNet多传感器融合的珊格定位更精准,语义更丰富,结果更明确,可以提供准确且丰富的底层感知建模信息,这对城市NOA这种复杂的交通场景异常重要。

占据栅格的多种结果

OmniNet输出的多任务结果在后融合阶段可相互补充,互相验证。如图像语义点云信息Semantic Vidar和检测信息相结合,可进一步提高障碍物的召回率,将安全事故发生率降至最低。

Depth、Semantic和Vidar伪点云结果

车端更适配:更高的算力资源利用率,更低的迁移成本,更好的符合车企泛化需求

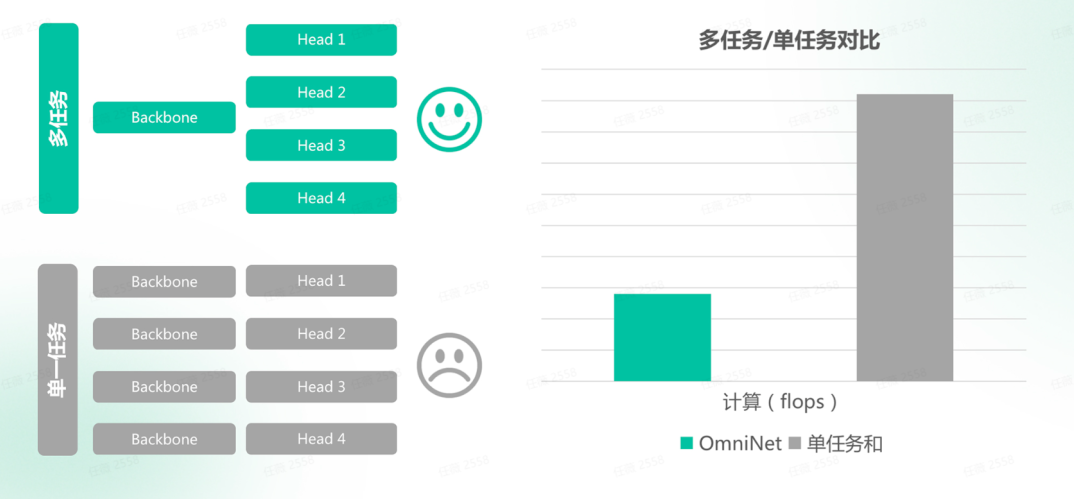

OmniNet可以让本来独立的各个计算任务通过共享主干网络(backbone)和记忆网络(Memory network)进行高效多任务统一计算。

在完成相同数量任务的基础上,OmniNet可以节省2/3的算力,助力打造高投入产出比的方案,完全满足车规级芯片的应用需求。

在应用这种全能大模型之前,各任务通过单独模型分别处理,不可避免地会造成重复计算,徒增功耗,不利于车规级应用。而统一的时序多模态特征融合的大模型,让各模型的主干网络部分可以共用,避免了大量重复计算,也无需再对不同任务开发不同的网络模型。

多任务/单一任务对比

由于不同传感器的数据可以无缝融合,因此轻舟的感知方案可以灵活适配不同车型的传感器配置,而无需针对不同的硬件配置进行单独的模型训练,带来了更低的迁移成本。

同时,可选的松耦合度融合方式带来了更强的系统泛化性,可高效适配不同厂家、不同频率的传感器输入,为主机厂提供更宽泛的传感器选择和更灵活的安装布局,从而满足车厂对低、中、高级别传感器随机应变的需求,有力支撑主机厂平台化方案设计。

迭代更高效:更适宜使用数据驱动的算法开发模式,有效解决实际道路场景面临的长尾问题

相较于传统的基于启发式算法的开发模式,OmniNet采用了数据驱动的算法开发模式,通过数据闭环实现算法的高效迭代,不仅可显著缩短算法迭代周期,减少模型维护成本,同时效果也更加可靠,有利于高效解决自动驾驶面临的各类长尾问题。

OmniNet的应用将让车辆具备一个会自主学习、能够辨识万物的大脑,而非背着一本写好的「词典」,需不断手动增补词条才能遍历各种场景元素。

将激光雷达「物尽其用」:边际效益最大化,场景认知更深刻

作为高等级的自动驾驶公司,轻舟智航具备丰富的激光雷达应用经验,并拥有充分的场景和数据积累。此次推出时序多模态特征融合的大模型OmniNet,可以进一步充分发挥激光雷达的优势,帮助理解场景元素的更深层次的内在联系,发挥融合和数据的价值,以一颗激光雷达实现城市NOA。

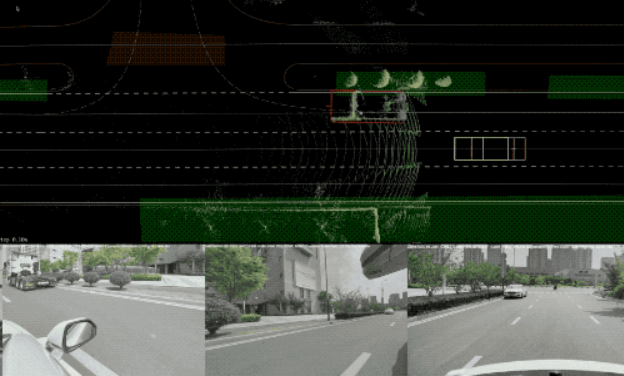

实现一颗激光雷达的城市NOA,首先得益于轻舟超融合感知的能力。即使前向120度的激光雷达看不到后方,但通过时序和空间融合算法,在车行驶过程中,前向激光雷达扫过的区域会在系统时刻进行记忆,并在车往前行进后将记忆区域的点云数据,与侧向后向的纯视觉信息进行补充和融合,从而保证对前后向区域的充分认知。

另一方面,使用120度激光雷达即足以处理绝大部分自车需要关心的复杂场景。由于自车在向前移动时,道路上最容易干扰自车行驶的是前向静态物体和低速物体,换句话说,潜在交互场景主要出现在自车正前及侧前方。

而倒车场景一般在较低速道路或停车场,自车和其他交通参与者速度都不高,无需依赖激光雷达也可以完成基本倒车场景功能。

因此,一颗激光雷达的城市NOA可以获得最大的边际效益,以更低的硬件成本,满足复杂的场景,并让更多用户享受到自动驾驶的技术红利。加装一个激光雷达需要更多算力支持,在非重点区域增加更多激光雷达带来的边际收益并不高。

在此基础上,轻舟智航更充分利用在激光雷达方面的丰富经验,实现了行业领先的通用障碍物识别能力,研发了先进的噪声过滤方案,有效应对城市NOA在使用中的各类场景难题。

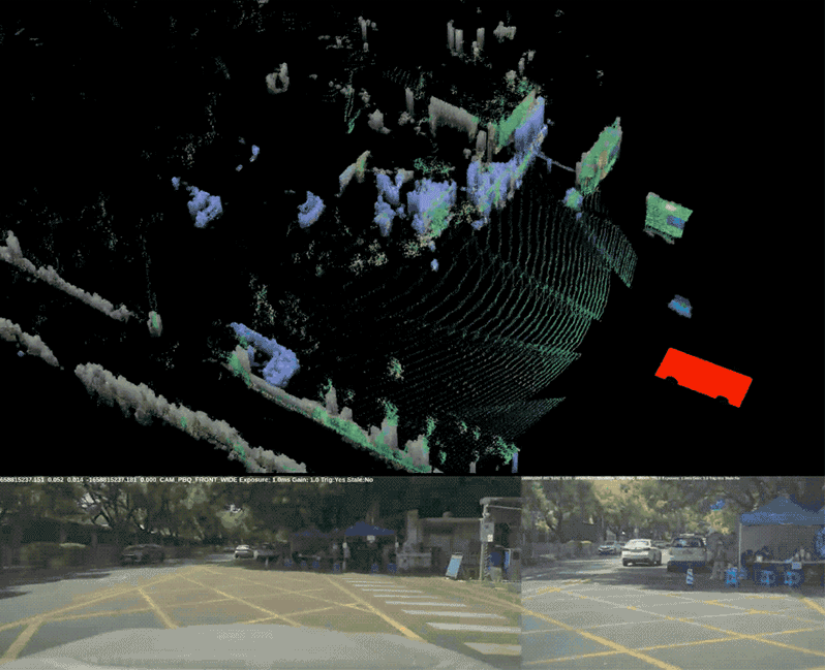

首先,轻舟的通用障碍物识别能力,可在不知物体类别的情况下对物体进行检出。在激光雷达扫描到的区域,轻舟可以针对障碍物体每一个占据格栅的信息,都输出类别、属性、状态,不仅能有效识别车辆、人群、植被、护栏、锥桶、小动物、施工区域等常见的道路交通参与元素,各类陌生或长尾罕见的异形障碍物,即使不属于交通参与者也可以识别并快速做出反应。这有利于搭载城市NOA的量产车去应对在各地城市中可能会出现的长尾问题。

精准识别核酸检测棚

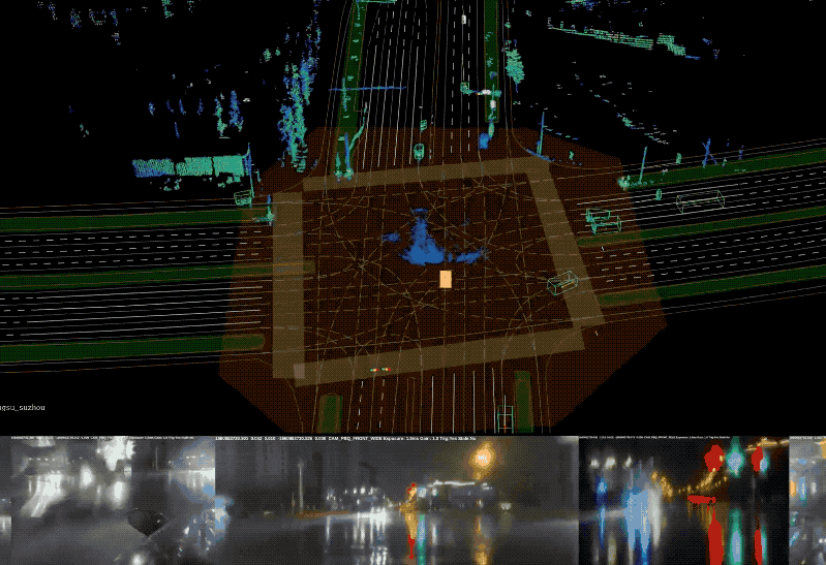

第二,安全有效的噪声过滤方案,可最大限度排除雨雾、泛光等噪声对感知的干扰。在真实的行车场景中,因雨雾造成的遮挡,地面积水造成的泛光和反射等,会给激光雷达点云信息带来噪声干扰,是激光雷达感知的一项重要挑战。

噪声的干扰会极大影响自动驾驶系统的决策,造成无故刹车、并线等错误判断,影响安全性。对此,轻舟的研发团队深入挖掘了点云噪声产生的原理,同时依托强大的数据驱动能力,设计了逐层递进的噪声过滤方案,能够在确保过滤安全性的同时,有效排除这些极端环境因素对感知的干扰。

感知不受雨水、泛光、反光的干扰

通过与激光雷达的融合,轻舟的多传感器融合感知性能显著提升。例如,针对行人和车辆的尺寸误差估计相较纯视觉方案的10%降低至1%以下,速度估计误差从30%左右降低至10%以下。

不久前,轻舟智航正式公布了配备一颗前向120度车规级激光雷达的自动驾驶汽车,在城市道路中完成多种高难度挑战的视频集锦,其中涉及高架立交桥下路况恶劣的路口、多车和大车混杂路况下的相互博弈、多层停车楼的精准定位和连续过弯等复杂场景,正是轻舟智航可靠的超融合感知能力的体现。

未来,随着激光雷达在乘用车领域搭载量的不断提升,轻舟的「超融合」感知方案将为城市NOA在多场景的应用发挥更多突出作用和重要价值。作为高等级自动驾驶公司,轻舟智航将其领先的公开道路L4级自动驾驶能力赋能于城市NOA方案的研发,将助力车企实现性能、成本和适配灵活性兼顾的城市NOA方案,真正实现能用、好用、爱用的辅助驾驶,让开车像打车一样轻松、便捷。